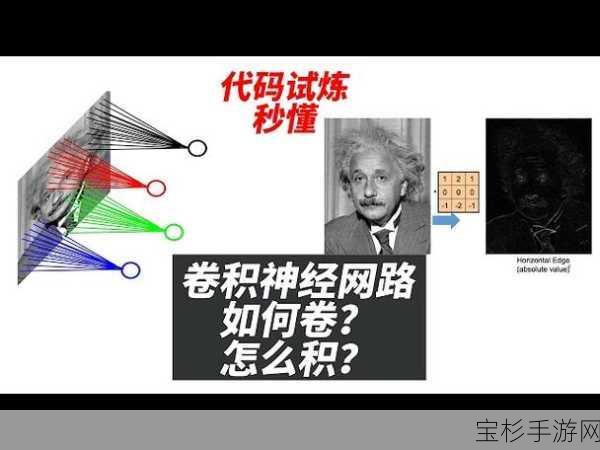

嘿,各位小伙伴们,我是阿秋,今天咱们来聊聊一个听起来高大上,但实际上并不那么神秘的东西——卷积神经网络(CNN),别被它的名字吓到,哪怕你是零基础,只要跟着我的思路走,保证你能搞懂这个在图像识别和深度学习领域大放异彩的家伙。

咱们得明白,卷积神经网络是干啥的,它就是用来处理图像数据的神经网络,想象一下,你有一张图片,CNN能帮你识别出图片里的内容,比如是猫、狗还是汽车,厉害吧?但它是怎么做到的呢?别急,咱们一步步来。

CNN的基本结构,主要包括输入层、卷积层、激活函数、池化层、全连接层和输出层,听起来很复杂,但其实每个部分都有它的作用,咱们一个个来看。

输入层:这个很简单,就是你给CNN看的图片,图片在计算机里就是一堆数字,每个数字代表图片上一个点的颜色,输入层就是这些数字的集合。

卷积层:这是CNN的核心部分,卷积层里有很多卷积核(也叫滤波器),这些卷积核就像一个个小窗口,在图片上滑来滑去,每次滑到一个位置,就计算一下窗口里数字的和(或者更复杂的运算),这样,卷积核就能提取出图片的一些特征,比如边缘、纹理之类的。

你可能会问,卷积核是怎么知道要提取什么特征的?卷积核里的数字是训练出来的,一开始,这些数字是随机的,但CNN会在训练过程中不断调整它们,直到能准确地提取出图片的特征。

激活函数:激活函数的作用是给卷积层的输出加点“非线性”,为什么要加非线性呢?因为线性运算太简单了,处理不了复杂的问题,激活函数就像给CNN加了个“开关”,让它的输出能变得更灵活、更强大。

池化层:池化层的作用是对卷积层的输出进行降维,也就是减少数据的数量,这样做的好处是,可以减少计算量,防止过拟合(就是模型太复杂了,反而学不到真正的东西),池化层常用的方法有最大池化和平均池化,最大池化就是取窗口里的最大值,平均池化就是取窗口里的平均值。

全连接层:全连接层就是传统的神经网络层了,它的作用是对前面提取的特征进行组合和分类,就是把卷积层和池化层提取出来的特征,送到全连接层里,让它判断图片是什么。

输出层:输出层就是CNN的“嘴巴”,它会把全连接层的输出变成我们能看懂的东西,在图像分类任务里,输出层可能会输出一个概率分布,告诉我们图片是猫、狗还是汽车的概率。

好了,说了这么多,你可能已经对CNN有个大概的了解了,但别忘了,理论只是基础,真正要掌握CNN,还得多动手实践,你可以找一些开源的CNN框架(比如TensorFlow、PyTorch)来练练手,自己动手搭建一个CNN模型,处理一些图像数据,相信我,当你看到自己的模型能准确地识别出图片里的内容时,那种成就感是无法用言语来表达的。

阿秋想说,学习CNN(或者其他任何技术)都不是一蹴而就的事情,你可能会遇到很多困难和挫折,但只要你坚持下去,不断学习和实践,就一定能掌握它,加油!